L’IA fait irruption dans nos vies depuis quelques mois maintenant. Mais passé l’émerveillement des premières utilisations de Chat GPT, se pose la question d’un usage plus profond et pertinent pour son propre travail. Et si les journalistes montraient la voie ? Plusieurs médias planchent sur les façons d’utiliser l’IA mais aussi de faire face à l’usage de leurs données pour entraîner les robots. Petit guide.

Récemment, plusieurs médias français et internationaux ont décidé de fermer leurs productions à l’usage des intelligences artificielles. Comprendre : les IA, qui doivent s’entrainer en « lisant » des milliards de données ne pourront plus utiliser les articles et publications webs de ces médias. C’est le cas de notamment de Radio France et Tf1 qui ont décidé pendant l’été de refuser de mettre à disposition leurs données pour entraîner les IA, à l’instar de ce qu’a décidé le New York Times. Derrière cette « fermeture », on voit poindre une inquiétude forte autour du droit, de la protection des données, du droit d’auteur. Une inquiétude que l’europe a en tête mais qui peine encore à trouver une réponse législative claire et forte.

Ne plus se laisser piller par les IA, donc. Mais, d’un autre côté, ne pas non plus se fermer totalement à cette rupture technologique. A ce titre, de nombreux médias continuent de réfléchir à l’usage possible de l’IA et notamment des gros modèles de langage type Chat GPT. Nous avons listé ci-dessous quelques enseignements issus des pratiques actuelles et des prospections de divers médias français et internationaux.

Quelques usages de l’IA pour les journalistes…et les non journalistes

- Elaborer une ébauche de plan d’article : simple, efficace, cela peut vous permettre d’y voir plus clair en amont d’une rédaction. Même si, évidemment, il faudra tout vérifier ensuite.

- Optimiser voire automatiser la transcription et le relevé des citations les plus pertinentes issues d’un texte/prise de note : le Center for Cooperative Media propose ici un guide utile.

- Anticiper les pièges : autre exemple d’utilisation, demander au robot d’anticiper les pièges et difficultés possibles qui surviendrait dans la réalisation de votre tâche. Certes, cela peut déprimer un peu mais c’est aussi une bonne manière de parer à toute éventualité.

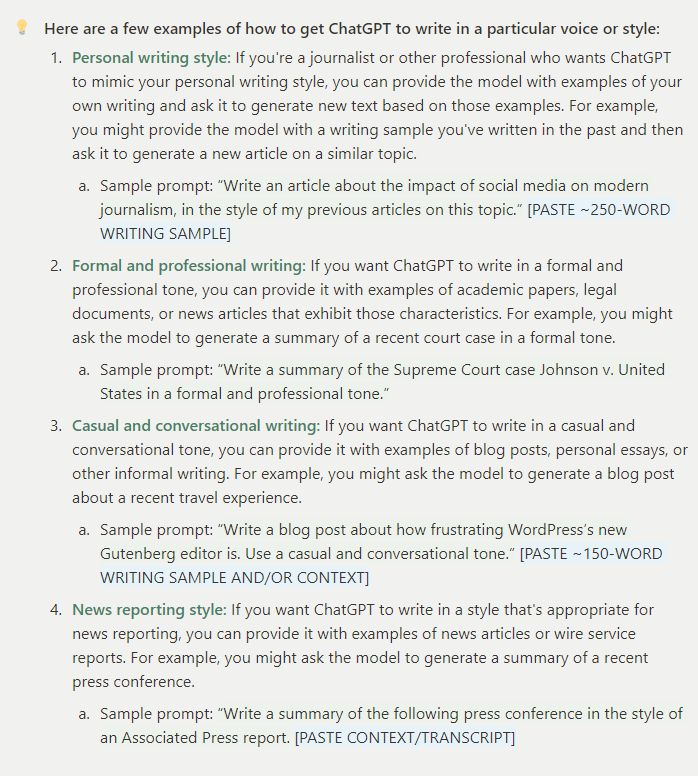

- Utiliser l’IA pour tester des styles d’écriture : vous pouvez opter pour ce qu’on appelle la génération conditionnelle de texte, c’est-à-dire demander à l’IA d’écrire dans un style particulier. Cela demande un peu de temps notamment en donnant au robot des modèles à suivre. Mais cela peut s’avérer bluffant comme l’a montré avec humour et intelligence le youtubeur français et agrégé de philosophie Monsieur Phi. Notez que vous pouvez aussi entrainer l’IA à écrire dans votre style à vous, en lui fournissant de nombreux textes de votre cru.

Exemple livré par le Center for Cooperative Media

Et l’éthique dans tout ça ?

Le Conseil de déontologie journalistique et de médiation a récemment publié ses recommandations sur l’usage de l’IA dans le journalisme. Un travail très intéressant au-delà même de la profession de journaliste.

Le CDJM relève d’abord ce qu’il appelle des usages à risque faible :

- la correction orthographique et grammaticale d’un texte avant publication

- la traduction automatisée de textes à des fins de documentation préalable

- la transcription d’enregistrements (speech to text) pour en extraire

- des citations pertinentes

- la création de brouillons pour les publications qu’on souhaite diffuser

- sur les réseaux sociaux

- la génération d’idées de titres optimisés pour le référencement

- l’aide au repérage et au choix des informations qui circulent sur les

- réseaux sociaux

- l’analyse et la synthèse de dossiers complexes lors de recherches préparatoires

- la vérification d’affirmations (fact checking) en temps réel via des outils utilisés en interne

Risque déontologique faible, certes, mais qui ne peut pas aller sans une vérification et une validation de chaque suggestion, de chaque production assistée par l’IA.

Viennent ensuite des usages à risque modéré, qui « peuvent avoir un impact sur l’information publiée ou diffusée ». Ces usages doivent être signalés pour que toute personne consultant les productions sache qu’il s’agit d’un travail assisté de l’IA.

Cela comprend notamment :

- la traduction automatisée d’articles publiés dans une langue étrangère

- la synthèse vocale avancée (text to speech) pour la lecture orale automatique de textes

- la mise à jour automatisée d’un contenu en fonction de nouvelles

- données disponibles

- le classement d’articles par mots-clés

- des résumés d’articles ou d’éléments audiovisuels

- la génération de versions en français simplifié

- la synthèse factuelle de résultats électoraux

- le compte-rendu technique d’une rencontre sportive

On voit ici qu’il ne s’agit plus d’utiliser l’IA comme un outil d’aide mais presque comme un alter égo en produisant des contenus entiers. Ces usages vont donc exiger une vigilance immense de la part des journalistes aussi bien sur les informations de départs dispensées au robot et bien sûr sur le produit final.

Signaler que le contenu a été généré par IA suffit-il ?

Non. Non. Et non. Lisez-vous les petits caractères ? Prêtez-vous systématiquement attention aux légendes des photos ? Bien sûr que non. Signaler en tout petit et en italique sous une photo qu’elle a été généré par l’IA ne suffit pas car cela peut échapper au public. Mieux vaut donc ajouter une mention claire sur l’image elle-même, lorsqu’il s’agit d’une image.

Et surtout, » des contenus générés en intégralité par des outils d’IA ne peuvent être publiés ou diffusés sans contrôle éditorial » souligne le CDJM, qui ajoute : « Les éditeurs et les rédactions sont responsables de ces contenus, au même titre que des productions humaines ; leur diffusion doit donc se faire exclusivement sous la supervision des journalistes, après des étapes de relecture et de validation qui garantissent au lecteur la véracité et la qualité de l’information publiée ou diffusée ».

Enfin, parmi les autres recommandations du CDJM, celle qui aux yeux du CFPJ apparait comme centrale est bien entendu la nécessité de se former.

Pour aller plus loin :

Notre formation d’initiation à l’IA pour produire textes et images

Notre nouvelle formation pour optimiser son écriture web avec l’IA